Perché il Deep Learning viene sempre eseguito sui dati di tipo Array? Nuove ricerche sull’IA introducono ‘Spatial Functa’, in cui i dati vengono trattati come un’unica entità, da data a funzione.

Il Deep Learning viene eseguito sui dati di tipo Array perché rappresentano un modo efficace per organizzare e manipolare i dati in modo efficiente. Le nuove ricerche sull'IA introducono il concetto di 'Spatial Functa', in cui i dati sono trattati come un'unica entità, da data a funzione.

Le rappresentazioni neurali implicite (INR) o campi neurali sono reti neurali basate sulle coordinate che rappresentano un campo, come una scena 3D, mappando le coordinate 3D ai valori di colore e densità nello spazio 3D. Recentemente, i campi neurali hanno guadagnato molta attenzione nella computer vision come mezzo per rappresentare segnali come immagini, forme/scene 3D, film, musica, immagini mediche e dati meteorologici.

Al contrario dell’approccio tradizionale di elaborare rappresentazioni di matrici come i pixel, recenti lavori hanno proposto un framework chiamato functa per eseguire deep learning direttamente su queste rappresentazioni di campo. Si comportano bene in molte aree di ricerca, compresa la generazione, l’inferenza e la classificazione. Vanno dalle immagini ai voxel ai dati climatici alle scene 3D, ma tipicamente funzionano solo con dataset piccoli o semplici come CelebA-HQ 64 64 o ShapeNet.

I precedenti lavori su functa hanno dimostrato che il deep learning su campi neurali è possibile per molte diverse modalità, anche con dataset relativamente piccoli. Tuttavia, il metodo ha ottenuto risultati scadenti nelle attività di classificazione e generazione di CIFAR-10. Questo è stato sorprendente per i ricercatori perché le rappresentazioni di campo neurali di CIFAR-10 erano così accurate che contenevano tutti i dati necessari per completare le attività successive.

- La guida al campo dei dati sintetici

- Una nuova ricerca sull’IA presenta AttrPrompt un generatore di dati di addestramento LLM per un nuovo paradigma nell’apprendimento Zero-Shot

- 4 Idee Statistiche Importanti Che Dovresti Comprendere in un Mondo Guidato dai Dati

Uno studio recente condotto da DeepMind e dall’Università di Haifa presenta una strategia per estendere l’applicabilità di functa a set di dati più estesi e complessi. Innanzitutto, mostrano che i risultati riportati di functa su CelebA-HQ possono essere replicati utilizzando la loro metodologia. Successivamente, la applicano alle attività successive su CIFAR-10, dove i risultati in termini di classificazione e generazione sono sorprendentemente scadenti.

Come estensione di functa, spatial functa sostituisce i vettori latenti piatti con rappresentazioni di variabili latenti ordinate spazialmente. Di conseguenza, le caratteristiche in ciascun indice spaziale possono raccogliere informazioni specifiche di quella posizione anziché raccogliere dati da tutte le posizioni possibili. Questo piccolo aggiustamento consente di utilizzare architetture più sofisticate per risolvere le attività successive, come i Transformers con codifiche posizionali e gli UNets, le cui tendenze induttive sono ben adatte ai dati organizzati spazialmente.

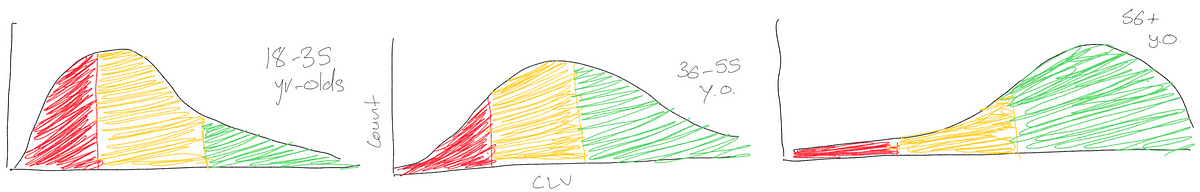

Ciò consente al framework functa di scalare a set di dati complessi come ImageNet-1k con una risoluzione di 256 x 256. I risultati mostrano anche che i vincoli riscontrati nella classificazione/generazione di CIFAR-10 sono risolti da spatial functa. I risultati nella classificazione sono paragonabili a quelli di ViTs e nella produzione di immagini sono paragonabili a quelli di Latent Diffusion.

Il team ritiene che il framework functa brillerà su larga scala in queste modalità di dimensioni superiori perché i campi neurali catturano le grandi quantità di informazioni ridondanti presenti nelle rappresentazioni di matrici di queste modalità in modo molto più efficiente.