Questo strumento di intelligenza artificiale spiega come l’IA vede le immagini e perché potrebbe confondere un astronauta con una pala.

Questo strumento di IA spiega come l'IA vede le immagini e perché confonde un astronauta con una pala.

È ampiamente riconosciuto che l’intelligenza artificiale (IA) ha compiuto progressi significativi negli ultimi anni, portando a risultati straordinari e innovativi. Tuttavia, non è vero che l’IA possa ottenere risultati altrettanto impressionanti in tutte le attività. Ad esempio, mentre l’IA può superare le prestazioni umane in determinate attività visive, come il riconoscimento facciale, può anche mostrare errori sorprendenti nell’elaborazione e classificazione delle immagini, mettendo in evidenza la natura complessa del compito. Di conseguenza, comprendere il funzionamento interno di tali sistemi per il compito specifico e come arrivano a determinate decisioni è diventato oggetto di grande interesse e indagine da parte dei ricercatori e degli sviluppatori. È noto che, simili al cervello umano, i sistemi di intelligenza artificiale utilizzano strategie per analizzare e categorizzare le immagini. Tuttavia, i meccanismi precisi di questi processi rimangono sfuggenti, risultando in un modello a scatola nera.

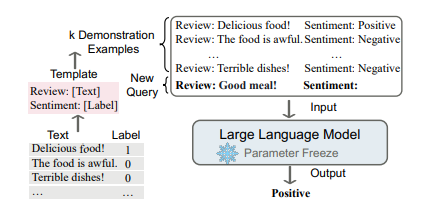

Pertanto, c’è una crescente domanda di metodi di spiegabilità per interpretare le decisioni prese dai moderni modelli di apprendimento automatico, in particolare le reti neurali. In questo contesto, i metodi di attribuzione, che generano mappe di calore indicando l’importanza dei singoli pixel nell’influenzare la decisione di un modello, hanno guadagnato popolarità. Tuttavia, recenti ricerche hanno evidenziato i limiti di questi metodi, poiché tendono a concentrarsi solo sulle regioni più salienti di un’immagine, rivelando dove il modello guarda senza chiarire ciò che il modello percepisce in quelle aree. Pertanto, per svelare le reti neurali profonde e scoprire le strategie utilizzate dai sistemi di intelligenza artificiale per elaborare le immagini, un team di ricercatori dell’Institute for Brain Science dell’Università di Brown e alcuni informatici dell’Artificial and Natural Intelligence Toulouse Institute, in Francia, hanno collaborato per sviluppare CRAFT (Concept Recursive Activation FacTorization for Explainability). Questo innovativo strumento si propone di individuare il “cosa” e il “dove” su cui si concentra un modello di intelligenza artificiale durante il processo decisionale, mettendo così in evidenza le differenze nella comprensione delle informazioni visive tra il cervello umano e un sistema di visione artificiale. Lo studio è stato anche presentato alla prestigiosa Conferenza su Visione Artificiale e Riconoscimento dei Pattern, 2023, tenutasi in Canada.

Come accennato in precedenza, comprendere come i sistemi di intelligenza artificiale prendano decisioni utilizzando specifiche regioni di un’immagine tramite metodi di attribuzione è stato un compito difficile. Tuttavia, identificare semplicemente le regioni influenti senza chiarire perché quelle regioni siano cruciali non fornisce una spiegazione completa agli esseri umani. CRAFT affronta questa limitazione sfruttando le moderne tecniche di apprendimento automatico per svelare le rappresentazioni visive complesse e multidimensionali apprese dalle reti neurali. Al fine di migliorare la comprensione, i ricercatori hanno sviluppato un sito web intuitivo in cui gli individui possono esplorare e visualizzare in modo semplice questi concetti fondamentali utilizzati dalle reti neurali per classificare gli oggetti. Inoltre, i ricercatori hanno sottolineato che con l’introduzione di CRAFT, gli utenti non solo acquisiscono una comprensione dei concetti utilizzati da un sistema di intelligenza artificiale per costruire un’immagine e comprendere ciò che il modello percepisce in aree specifiche, ma anche capiscono la gerarchia di questi concetti. Questo progresso innovativo offre una preziosa risorsa per svelare il processo decisionale dei sistemi di intelligenza artificiale e migliorare la trasparenza nei loro risultati di classificazione.

- Cos’è un Field Programmable Gate Array (FPGA) FPGA vs GPU per l’Intelligenza Artificiale (IA)

- Google AI presenta i plugin di diffusione di MediaPipe che consentono la generazione controllabile di testo in immagini su dispositivo.

- Salesforce presenta XGen-7B una nuova LLM (Lingua Naturale) addestrata su 7B (miliardi) di esempi con una lunghezza di sequenza fino a 8K (8.000) per 1,5T (trilioni) di token.

In sostanza, i principali contributi del lavoro svolto dai ricercatori possono essere riassunti in tre punti principali. Innanzitutto, il team ha ideato un approccio ricorsivo per identificare ed analizzare in modo efficace i concetti in più strati. Questa strategia innovativa consente una comprensione completa dei componenti sottostanti alla rete neurale. In secondo luogo, è stato introdotto un metodo rivoluzionario per stimare accuratamente l’importanza dei concetti mediante l’utilizzo degli indici Sobol. Infine, l’implementazione della differenziazione implicita ha rivoluzionato la creazione di Concept Attribution Maps, aprendo così la strada a uno strumento potente per visualizzare e comprendere l’associazione tra concetti e caratteristiche a livello di pixel. Inoltre, il team ha condotto una serie di valutazioni sperimentali per dimostrare l’efficienza e l’importanza del loro approccio. I risultati hanno rivelato che CRAFT supera tutti gli altri metodi di attribuzione, consolidando la sua notevole utilità e affermandosi come un punto di partenza per ulteriori ricerche nei metodi di spiegabilità basati su concetti.

I ricercatori hanno anche sottolineato l’importanza di comprendere come i computer percepiscono le immagini. Acquisendo profonde conoscenze sulle strategie visive utilizzate dai sistemi di intelligenza artificiale, i ricercatori ottengono un vantaggio competitivo nel migliorare l’accuratezza e le prestazioni degli strumenti basati sulla visione. Inoltre, questa comprensione si rivela utile contro gli attacchi avversari e informatici, aiutando i ricercatori a capire come gli aggressori possano ingannare i sistemi di intelligenza artificiale attraverso sottili alterazioni delle intensità dei pixel in modi appena percettibili per gli esseri umani. Per quanto riguarda il futuro lavoro, i ricercatori sono entusiasti del giorno in cui i sistemi di visione artificiale potranno superare le capacità umane. Con il potenziale per affrontare sfide irrisolte come la diagnostica del cancro, il riconoscimento dei fossili, ecc., il team crede fermamente che questi sistemi abbiano il potere di trasformare numerosi settori.