Rinascimento digitale la ricerca di NVIDIA Neuralangelo ricostruisce scene 3D.

NVIDIA Neuralangelo's research reconstructs 3D scenes in the digital Renaissance.

Neuralangelo, un nuovo modello di AI sviluppato da NVIDIA Research per la ricostruzione 3D tramite reti neurali, trasforma i video clip 2D in dettagliate strutture 3D, generando repliche virtuali di edifici, sculture e altri oggetti del mondo reale.

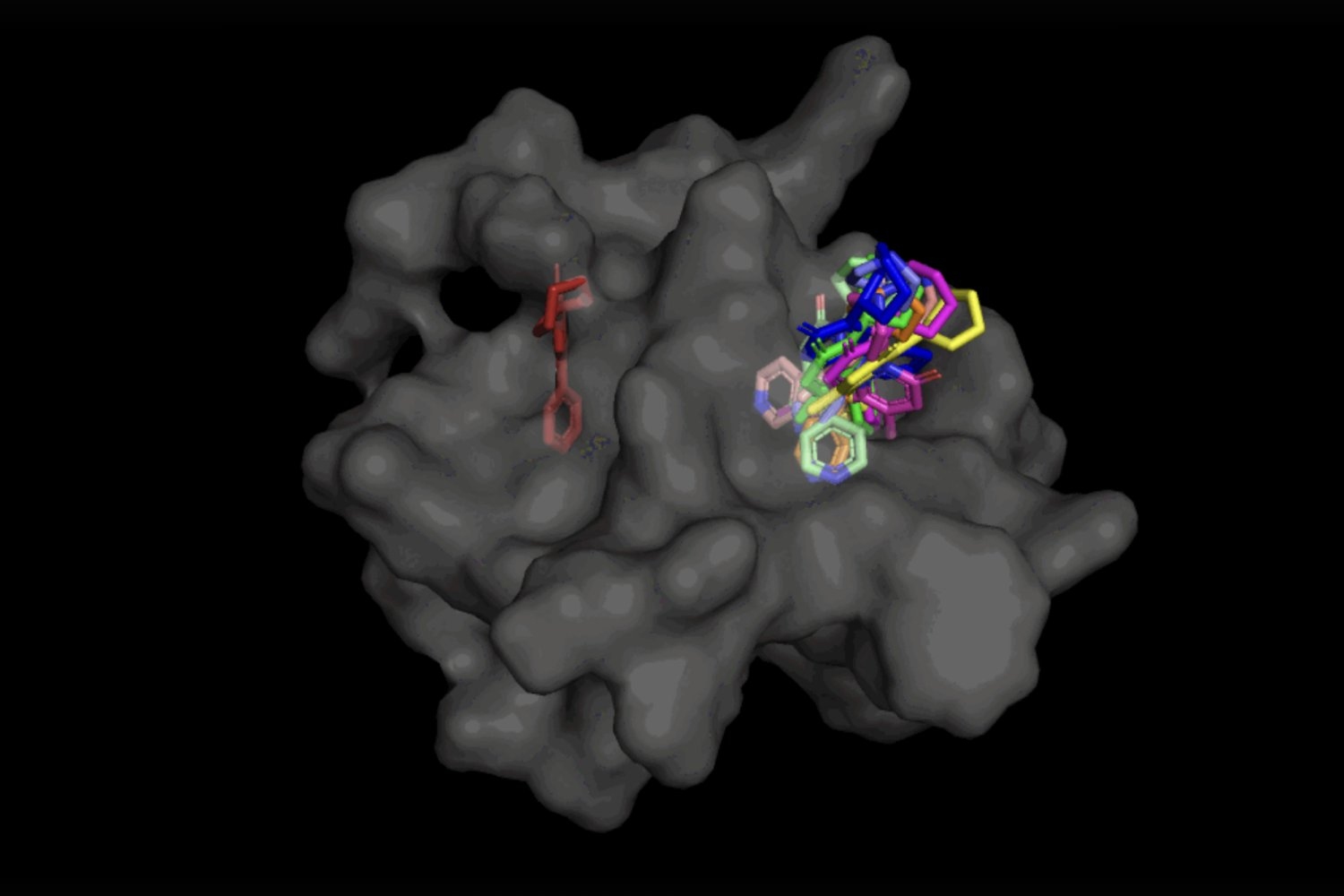

Come Michelangelo che scolpiva visioni sorprendentemente realistiche da blocchi di marmo, Neuralangelo genera strutture 3D con dettagli e texture intricate. I professionisti creativi possono importare questi oggetti 3D in applicazioni di progettazione, modificarli ulteriormente per l’uso in arte, sviluppo di videogiochi, robotica e gemelli digitali industriali.

La capacità di Neuralangelo di tradurre le texture di materiali complessi, tra cui tegole, lastre di vetro e marmo liscio, da video 2D a oggetti 3D supera significativamente i metodi precedenti. L’alta fedeltà rende le sue ricostruzioni 3D più facili per gli sviluppatori e i professionisti creativi per creare rapidamente oggetti virtuali utilizzabili per i loro progetti utilizzando filmati registrati con smartphone.

“Le capacità di ricostruzione 3D offerte da Neuralangelo saranno un enorme vantaggio per i creatori, aiutandoli a ricreare il mondo reale nel mondo digitale”, ha detto Ming-Yu Liu, direttore senior della ricerca e co-autore del paper. “Questo strumento consentirà agli sviluppatori di importare oggetti dettagliati, sia che si tratti di piccole statue o di edifici massicci, in ambienti virtuali per videogiochi o gemelli digitali industriali”.

- NYU, NVIDIA collaborano su un grande modello di lingua per prevedere il ricovero del paziente.

- Integrare gli esseri umani con l’AI nella progettazione strutturale.

- Creazione di un vaccino versatile per affrontare il Covid-19 nelle sue molteplici forme

In una demo, i ricercatori di NVIDIA hanno mostrato come il modello potesse ricostruire oggetti iconici come il David di Michelangelo e oggetti comuni come un camion a piattaforma. Neuralangelo può anche ricostruire interni ed esterni di edifici, come dimostrato con un dettagliato modello 3D del parco del campus di NVIDIA nella Bay Area.

Il modello di rendering neurale vede in 3D

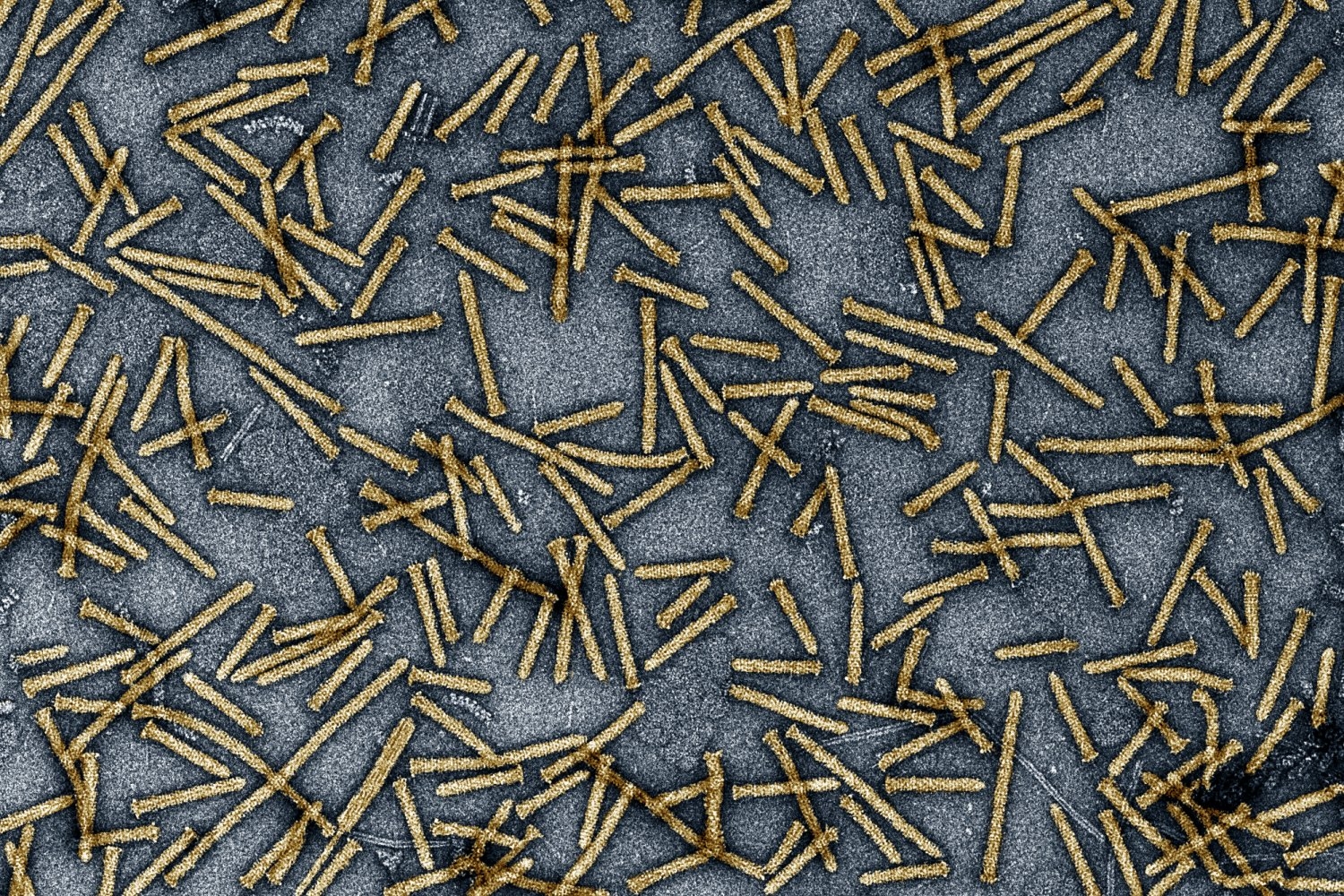

I modelli di AI precedenti per la ricostruzione di scene 3D hanno faticato a catturare accuratamente i pattern di texture ripetitivi, i colori omogenei e le forti variazioni di colore. Neuralangelo adotta primitive grafiche neurali istantanee, la tecnologia alla base di NVIDIA Instant NeRF, per aiutare a catturare questi dettagli più fini.

Utilizzando un video 2D di un oggetto o una scena filmata da diverse angolazioni, il modello seleziona diversi frame che catturano diverse visuali, come un artista che considera un soggetto da più lati per avere un senso di profondità, dimensioni e forma.

Una volta determinata la posizione della fotocamera di ciascun frame, l’AI di Neuralangelo crea una rappresentazione 3D grezza della scena, come uno scultore che inizia a scolpire la forma del soggetto.

Il modello ottimizza quindi il rendering per affinare i dettagli, proprio come uno scultore scolpisce attentamente la pietra per imitare la texture del tessuto o di una figura umana.

Il risultato finale è un oggetto 3D o una scena su larga scala che può essere utilizzato in applicazioni di realtà virtuale, gemelli digitali o sviluppo di robotica.

Trova la ricerca NVIDIA a CVPR, 18-22 giugno

Neuralangelo è uno dei quasi 30 progetti di NVIDIA Research che saranno presentati alla Conferenza sulla Visione Artificiale e il Riconoscimento dei Pattern (CVPR), che si terrà dal 18 al 22 giugno a Vancouver. I paper spaziano su argomenti tra cui stima della posa, ricostruzione 3D e generazione di video.

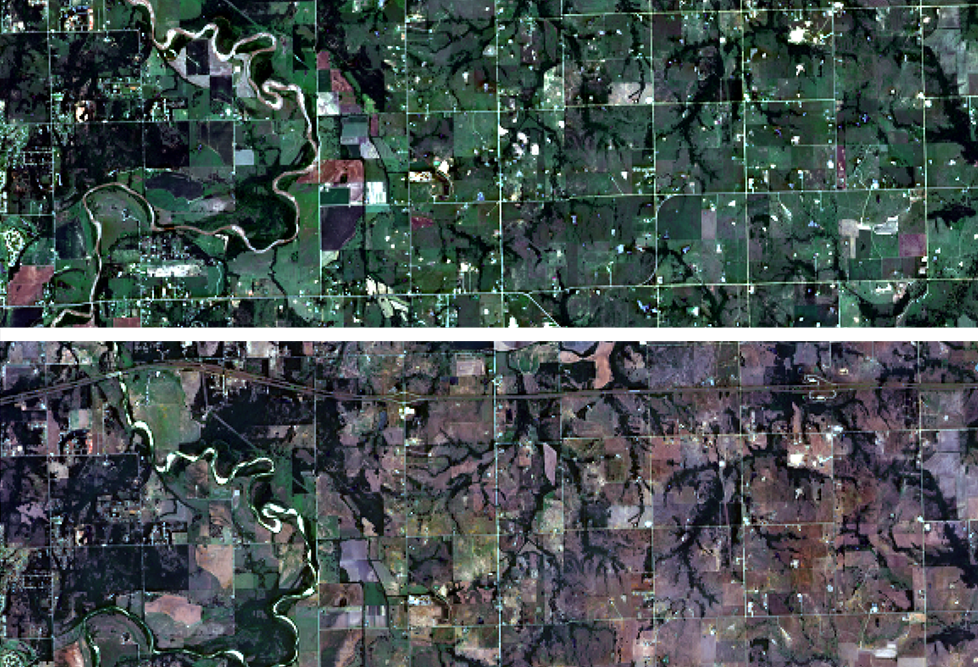

Uno di questi progetti, DiffCollage, è un metodo di diffusione che crea contenuti su larga scala, inclusi immagini a lunghezza d’onda paesaggistica, panorama a 360 gradi e immagini a movimento looped. Quando viene alimentato con un set di dati di formazione di immagini con un rapporto d’aspetto standard, DiffCollage tratta queste immagini più piccole come sezioni di una visualizzazione più grande, come pezzi di un collage. Ciò consente ai modelli di diffusione di generare grandi contenuti coerenti senza essere addestrati su immagini della stessa scala.

La tecnica può anche trasformare le prompt di testo in sequenze video, dimostrate utilizzando un modello di diffusione preaddestrato che cattura il movimento umano:

Scopri di più sulla ricerca NVIDIA a CVPR.