La guida definitiva per addestrare BERT da zero il Tokenizer

Guida addestramento BERT da zero Tokenizer

Dal Testo ai Token: La Tua Guida Passo-Passo alla Tokenizzazione BERT

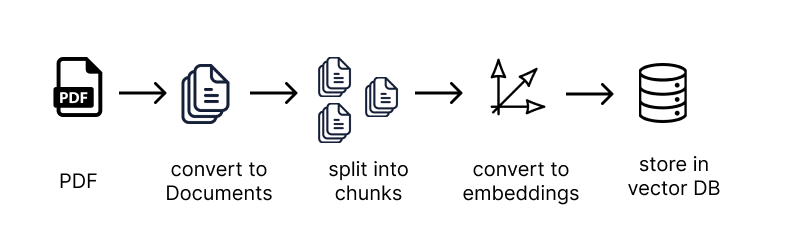

Sai che il modo in cui si tokenizza il testo può fare la differenza nel tuo modello di linguaggio? Hai mai voluto tokenizzare documenti in una lingua rara o in un dominio specializzato? Suddividere il testo in token non è un compito noioso, ma un passaggio fondamentale per trasformare il linguaggio in intelligenza applicabile. Questa storia ti insegnerà tutto ciò che devi sapere sulla tokenizzazione, non solo per BERT ma per qualsiasi altro LLM.

Nella mia ultima storia, abbiamo parlato di BERT, esplorato le sue basi teoriche e i meccanismi di addestramento, e discusso come affinarlo e creare un sistema di domande e risposte. Ora, mentre ci addentriamo nelle complessità di questo rivoluzionario modello, è il momento di mettere in luce uno degli eroi dimenticati: la tokenizzazione.

La Guida Definitiva all’Addestramento di BERT da Zero: Introduzione

Demistificando BERT: La definizione e le varie applicazioni del modello che ha cambiato il panorama NLP.

towardsdatascience.com

Capisco; la tokenizzazione potrebbe sembrare l’ultimo ostacolo noioso tra te e il processo entusiasmante di addestrare il tuo modello. Credimi, pensavo la stessa cosa. Ma sono qui per dirti che la tokenizzazione non è solo un “male necessario” – è una forma d’arte a sé stante.

- Top 50 strumenti di scrittura AI da provare (settembre 2023)

- Meta AI rilascia BELEBELE il primo benchmark di valutazione della comprensione della lettura parallela per 122 lingue

- Python in Excel Aprire la porta all’analisi avanzata dei dati

In questa storia, esamineremo ogni parte del processo di tokenizzazione. Alcuni passaggi sono banali (come la normalizzazione e la pre-elaborazione), mentre altri, come la modellazione, sono ciò che rende unico ogni tokenizer.

Quando avrai finito di leggere questo articolo, non solo comprenderai a fondo il tokenizer di BERT, ma sarai anche in grado di addestrarlo sui tuoi dati. E se ti senti avventuroso, avrai persino gli strumenti per personalizzare questo passaggio cruciale durante l’addestramento del tuo modello BERT da zero.

Suddividere il testo in token non è un compito noioso, ma un passaggio fondamentale per trasformare il linguaggio in intelligenza applicabile…