Turing Test, Stanza Cinese e Modelli di Linguaggio Avanzati

'Turing Test, Chinese Room, and Advanced Language Models'

Il Test di Turing è un’idea classica nel campo dell’IA. Originariamente chiamato gioco dell’imitazione, Alan Turing ha proposto questo test nel 1950, nel suo articolo “Computing Machinery and Intelligence”. Lo scopo del test è accertare se una macchina manifesta un comportamento intelligente al pari (e forse indistinguibile) da quello di un essere umano.

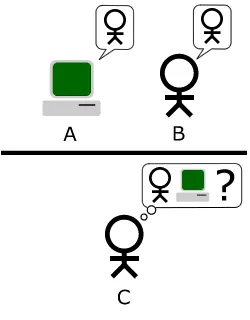

Il test funziona così: un interrogatore (giocatore C) si siede da solo in una stanza con un computer, che è collegato ad altre due stanze – e giocatori. Il giocatore A è un computer e il giocatore B è un essere umano. Il compito dell’interrogatore è determinare quale giocatore – A o B – è un computer e quale è un essere umano. L’interrogatore è limitato a digitare domande sul proprio computer e a ricevere risposte scritte.

Il test non indaga sul funzionamento dell’hardware o del cervello dei giocatori, ma cerca di testare il comportamento intelligente. Presumibilmente, un computer sufficientemente intelligente sarà in grado di fingersi un essere umano.

Il Test di Turing ha suscitato molto dibattito e controversie negli anni successivi e, con i modelli di linguaggio di grande dimensione (LLM) attuali, come ChatGPT, potrebbe essere utile mettere questo test al centro dell’attenzione.

- Decodifica del Codice di Abbigliamento 👗 Deep Learning per la Rilevazione Automatica degli Indumenti di Moda

- Impilando il nostro modo per robot più generali

- Hugging Face e AMD si sono uniti per accelerare modelli all’avanguardia per piattaforme CPU e GPU

I LLM superano il Test di Turing?

Prima di affrontare questa domanda, vorrei sottolineare che siamo creature della Natura (cosa che dimentichiamo a volte), che siamo arrivati qui attraverso l’evoluzione per selezione naturale. Questo comporta una serie di stranezze che sono dovute alla nostra storia evolutiva.

Una di queste stranezze è la nostra tendenza a attribuire agentività a oggetti inanimati. Hai mai dato un calcio alla tua auto e urlato: “Si accenderà mai?!” E pensa a quanti utenti di ChatGPT iniziano la loro richiesta con “Per favore”. Perché? Dopotutto, è solo un programma e mi importa poco se hai scritto “Per favore dimmi chi è Alan Turing?” o “Dimmi chi è Alan Turing”.

Ma questa è la nostra natura. Giriamo per il mondo attribuendo ogni tipo di proprietà a vari oggetti che incontriamo. Perché? Fondamentalmente, questo probabilmente era vantaggioso per la sopravvivenza, aiutandoci ad affrontare la natura.

Nel 1980, il filosofo John Searle ha presentato un argomento geniale contro la validità del Test di Turing come misura dell’intelligenza. L’argomento della stanza cinese (Menti, cervelli e programmi) sostiene che un computer che esegue un programma non può davvero avere una mente o una comprensione, indipendentemente da quanto intelligente o simile all’essere umano sia il suo comportamento.

Ecco come procede l’argomento: supponiamo che qualcuno crei un’intelligenza artificiale – eseguita su un computer – che si comporta come se capisse il cinese (forse un LLM?).

Il programma prende caratteri cinesi in input, segue il codice del computer e produce caratteri cinesi in output. E il computer lo fa in modo così convincente che supera brillantemente il Test di Turing: le persone sono convinte che il computer sia un parlante cinese in carne e ossa. Ha una risposta per tutto, in cinese.

Searle chiede: la macchina capisce davvero il cinese o sta simulando la capacità di comprendere il cinese?

Hmm…

Ora supponiamo che entri nella stanza e sostituisca il computer.

Ti assicuro che non parlo cinese (ahimè). Ma mi viene dato un libro, che è essenzialmente la versione in inglese del programma del computer (sì, è un libro voluminoso). Mi vengono anche forniti molti fogli di carta e tanti matite. C’è uno sportello nella porta attraverso il quale le persone possono inviarmi le loro domande, su fogli di carta, scritte in cinese.

Processo quei caratteri cinesi secondo il libro di istruzioni che ho — ci vorrà un po’ di tempo — ma, alla fine, attraverso una dimostrazione di pazienza assoluta, fornisco una risposta in cinese, scritta su un pezzo di carta. Poi mando la risposta nello scomparto.

Le persone fuori dalla stanza stanno pensando: “Ehi, il tipo là dentro parla cinese”. Di nuovo — io sicuramente non lo faccio.

Searle ha sostenuto che in realtà non c’è alcuna differenza tra me e il computer. Entrambi stiamo solo seguendo un manuale passo-passo, producendo un comportamento che viene interpretato come una conversazione intelligente in cinese. Ma né io né il computer parliamo veramente cinese, tanto meno lo capiamo.

E senza comprensione, ha argomentato Searle, non c’è pensiero in atto. Il suo argomento geniale ha dato origine a un dibattito acceso: “Beh, tutto il sistema — io, libro, matite — capisce il cinese”; “Non sono d’accordo, il sistema è solo un tipo e un gruppo di oggetti”; “Ma…” e così via, e così via.

Gli attuali LLM, come ChatGPT, sono estremamente bravi a tenere una conversazione. Passano il Test di Turing? Questa è una questione di opinione, e sospetto che le opinioni siano molto diverse, da “assolutamente no” a “Certo, ovvio”. La mia esperienza limitata con LLM suggerisce che sono vicini — ma non è come una sigaretta. A un certo punto della conversazione, di solito mi accorgo che è un’intelligenza artificiale, non un essere umano.

Ma anche se gli LLM avessero superato il Test di Turing, non posso fare a meno di pensare alla stanza di Searle.

Dubitare che ciò che stiamo vedendo ora sia una mente effettiva.

Per quanto riguarda il futuro? Mi affido al consulente di gestione Peter Drucker, che ha detto: “Cercare di prevedere il futuro è come guidare in una strada di campagna di notte senza luci guardando fuori dal finestrino posteriore”.

(e se un giorno avessero effettivamente una mente — non sarebbe come la nostra…)

Vedo Persone Morti, o È Intelligenza, Jim, Ma Non Come La Conosciamo

Date un’occhiata a questa immagine, il famoso quadro “American Gothic” di Grant Wood:

VoAGI.com