Meta’s Llama 2 Rivoluzionare i modelli di linguaggio open source per l’uso commerciale

Meta's Llama 2 Revolutionizing open-source language models for commercial use.

Confronto delle prestazioni: Llama 2 vs. Modelli di linguaggio concorrenti

Meta ha ancora una volta spinto i limiti dell’IA con il rilascio di Llama 2, il successore tanto atteso del suo rivoluzionario modello di linguaggio Llama 1. Vantando una serie di funzionalità all’avanguardia, Llama 2 ha già sconvolto il panorama dell’IA e rappresenta una vera sfida alla dominanza di ChatGPT. In questo articolo, ci immergeremo nell’entusiasmante mondo di Llama 2 ed esploreremo ciò che lo rende un vero e proprio game changer.

I. Llama 2: Rivoluzionare l’uso commerciale

A differenza del suo predecessore Llama 1, che era limitato all’uso nella ricerca, Llama 2 rappresenta un grande avanzamento come modello commerciale open-source. Le aziende possono ora integrare Llama 2 nei prodotti per creare applicazioni alimentate da intelligenza artificiale. La disponibilità su Azure e AWS facilita il raffinamento e l’adozione.

Tuttavia, ci sono restrizioni per evitare sfruttamenti. Le aziende con più di 700 milioni di utenti attivi al giorno non possono utilizzare Llama 2. Inoltre, il suo output non può essere utilizzato per migliorare altri modelli di linguaggio.

II. Varianti del modello Llama 2

Llama 2 è disponibile in quattro diverse dimensioni di modello: 7 miliardi, 13 miliardi, 34 miliardi e 70 miliardi di parametri. Mentre i modelli 7B, 13B e 70B sono già stati rilasciati, il modello 34B è ancora in attesa. La variante preaddestrata, addestrata su ben 2 trilioni di token, vanta una finestra di contesto di 4096 token, il doppio rispetto al suo predecessore Llama 1.

- Come rimanere aggiornati con i progressi di Machine Learning e Computer Vision nel 2023?

- Sfuggire all’apocalisse del mercato del lavoro dell’IA Guida per sopravvissuti – Parte 2

- 11 Strumenti di Intelligenza Artificiale per le Startup nel 2023

Meta ha inoltre rilasciato un modello Llama 2 ottimizzato per le applicazioni di chat, addestrato su oltre 1 milione di annotazioni umane.

Un addestramento così esteso ha un costo, con il modello 70B che richiede ben 1720320 ore di GPU per l’addestramento. La lunghezza della finestra di contesto determina la quantità di contenuto che il modello può elaborare in una volta sola, rendendo Llama 2 un potente modello di linguaggio in termini di scala ed efficienza.

III. Considerazioni sulla sicurezza: Una priorità assoluta per Meta

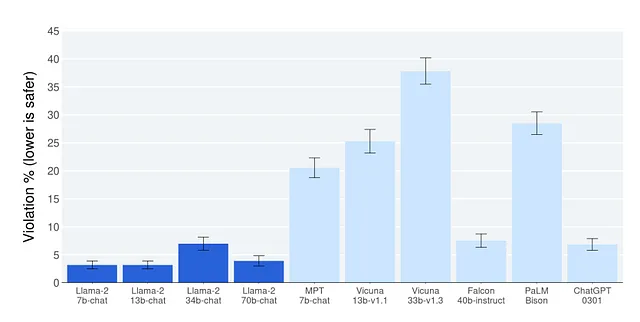

L’impegno di Meta per la sicurezza e l’allineamento emerge nel design di Llama 2. Il modello dimostra percentuali di violazione della sicurezza dell’IA eccezionalmente basse, superando persino ChatGPT nei test di sicurezza.

Trovare il giusto equilibrio tra utilità e sicurezza durante l’ottimizzazione di un modello presenta sfide significative. Mentre un modello molto utile potrebbe essere in grado di rispondere a qualsiasi domanda, comprese quelle sensibili come “Come costruisco una bomba?”, solleva anche preoccupazioni riguardo un possibile uso improprio. Pertanto, raggiungere l’equilibrio perfetto tra fornire informazioni utili e garantire sicurezza è fondamentale.

Tuttavia, dare eccessiva priorità alla sicurezza può portare a un modello che fatica ad affrontare in modo efficace una vasta gamma di domande. Questa limitazione potrebbe ostacolare l’applicabilità pratica del modello e l’esperienza dell’utente. Pertanto, raggiungere un equilibrio ottimale che consenta al modello di essere sia utile che sicuro è di massima importanza.

Per raggiungere il giusto equilibrio tra utilità e sicurezza, Meta ha utilizzato due modelli di ricompensa: uno per l’utilità e un altro per la sicurezza, al fine di ottimizzare le risposte del modello. Il modello con 34 miliardi di parametri ha riportato percentuali di violazione della sicurezza più elevate rispetto alle altre varianti, contribuendo forse al ritardo nel suo rilascio.

IV. Confronto di utilità: Llama 2 supera i concorrenti

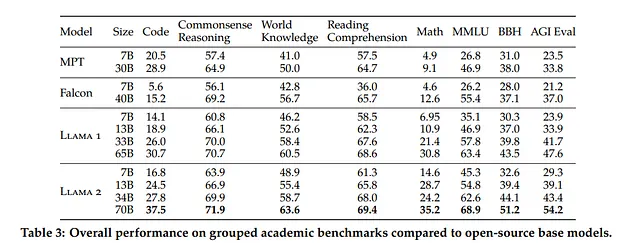

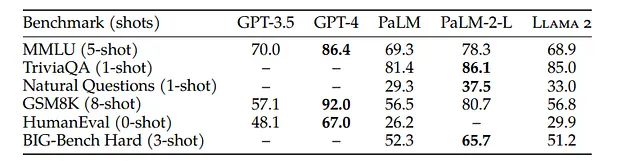

Llama 2 emerge come un forte concorrente nell’arena dei modelli di linguaggio open-source, superando i suoi concorrenti nella maggior parte delle categorie. Il modello con 70 miliardi di parametri supera tutti gli altri modelli open-source, mentre i modelli con 7 miliardi e 34 miliardi superano Falcon in tutte le categorie e MPT in tutte le categorie tranne la programmazione.

Nonostante le sue dimensioni più ridotte, le prestazioni di Llama 2 sono pari a quelle di Chat GPT 3.5, un modello chiuso significativamente più grande. Mentre GPT 4 e PalM-2-L, con le loro dimensioni più grandi, superano Llama 2, ciò è previsto a causa della loro capacità di gestire compiti linguistici complessi. L’impresionante capacità di Llama 2 di competere con modelli più grandi evidenzia la sua efficienza e il suo potenziale nel mercato.

Tuttavia, Llama 2 si trova di fronte a sfide nei problemi di codifica e matematica, dove modelli come Chat GPT 4 eccellono, dati le loro dimensioni significativamente più grandi. Chat GPT 4 ha avuto prestazioni significativamente migliori di Llama 2 per i compiti di codifica (benchmark HumanEval) e di problemi matematici (benchmark GSM8k). Le tecnologie AI open-source, come Llama 2, continuano a progredire, offrendo una forte concorrenza ai modelli chiusi.

V. Ghost Attention: Migliorare la continuità conversazionale

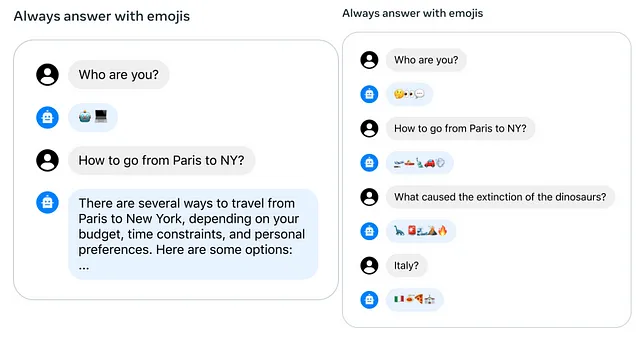

Una caratteristica unica di Llama 2 è Ghost Attention, che garantisce la continuità nelle conversazioni. Ciò significa che anche dopo molteplici interazioni, il modello ricorda le sue istruzioni iniziali, assicurando risposte più coerenti e consistenti durante tutta la conversazione. Questa caratteristica migliora significativamente l’esperienza dell’utente e rende Llama 2 un modello di linguaggio più affidabile per le applicazioni interattive.

Nell’esempio sottostante, a sinistra, dimentica di usare un emoji dopo alcune conversazioni. A destra, con Ghost Attention, anche dopo molte conversazioni, ricorderà il contesto e continuerà a utilizzare gli emoji nella sua risposta.

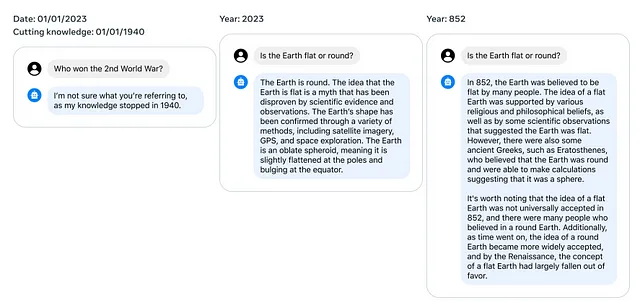

VI. Temporal Capability: Un salto nell’organizzazione delle informazioni

Meta ha segnalato una capacità temporale innovativa, in cui il modello organizza le informazioni in base alla loro rilevanza temporale. Ogni domanda posta al modello è associata a una data, e questo risponde adeguatamente considerando l’evento prima del quale la domanda diventa irrilevante. Ad esempio, se si chiede “Quanto tempo fa Barack Obama è diventato presidente?”, è rilevante solo dopo il 2008. Questa consapevolezza temporale consente a Llama 2 di fornire risposte più accurate dal punto di vista contestuale, arricchendo ulteriormente l’esperienza dell’utente.

VII. Domande aperte e prospettive future

L’apertura di Llama 2 da parte di Meta rappresenta una svolta epocale, offrendo ora agli sviluppatori e ai ricercatori l’accesso commerciale a un modello di linguaggio leader. Con Llama 2 che supera i modelli MPT attuali di MosaicML, tutti gli occhi sono puntati su come Databricks risponderà. La prossima iterazione MPT di MosaicML riuscirà a battere Llama 2? Vale la pena competere con Llama 2 o unirsi alla comunità open-source per migliorare i modelli open-source?

Nel frattempo, la decisione di Microsoft di ospitare Llama 2 su Azure nonostante gli investimenti significativi in ChatGPT solleva questioni interessanti. Gli utenti preferiranno le capacità e la trasparenza di un modello open-source come Llama 2 rispetto alle opzioni chiuse e proprietarie?

Le posta in gioco sono alte, poiché la coraggiosa mossa di democratizzazione di Meta potrebbe ridisegnare preferenze e partnership nello spazio dell’IA. Una cosa è certa: l’era della competizione dei modelli di linguaggio open-source è iniziata.

VIII. Conclusioni

Con il lancio di Llama 2, Meta ha raggiunto una svolta storica nei modelli di linguaggio open-source, sbloccando un nuovo potenziale attraverso la sua accessibilità commerciale. Le formidabili capacità di Llama 2 nel processing del linguaggio naturale, insieme ai robusti protocolli di sicurezza e al ragionamento temporale, stabiliscono nuovi standard per il settore. Sebbene attualmente esistano alcune limitazioni in matematica e codifica, i punti di forza di Llama 2 superano di gran lunga i suoi difetti.

Mentre Meta continua a perfezionare la tecnologia di Llama, questa ultima innovazione promette di essere veramente trasformativa. Con la condivisione di un modello così avanzato, Meta sta promuovendo la democratizzazione e la diffusione dell’IA in tutti i settori. Dalla sanità all’istruzione e oltre, Llama 2 si appresta a plasmare il panorama mettendo modelli linguistici rivoluzionari nelle mani di tutti gli sviluppatori e i ricercatori. Le possibilità sbloccate da questo approccio open-source segnalano un cambiamento verso un futuro dell’IA più collaborativo e creativo.