Svelando il futuro dell’IA con GPT-4 e l’IA comprensibile (XAI)

Futuro dell'IA con GPT-4 e l'IA comprensibile (XAI)

Introduzione

Nel mondo dell’Intelligenza Artificiale (AI) in continua evoluzione, GPT-4 è una meraviglia della generazione di testi simili a quelli umani. È come avere una conversazione con una macchina che parla la tua lingua. Ma ecco la novità: l’AI ha bisogno di più di parole di fantasia. Dobbiamo capire come pensa e decidere se possiamo fidarci di essa. Ecco dove entra in gioco l’AI Esplicabile (XAI). In questo articolo, capirai come si evolverà il futuro dell’AI con GPT-4 e l’AI Esplicabile (XAI) e colmare il divario.

Obiettivi di apprendimento

- Comprendere GPT-4: Scopri cosa è GPT-4, le sue capacità e perché è essenziale nell’AI.

- Scoprire l’AI Esplicabile (XAI): Esplora cosa significa XAI, perché è importante e come migliora la trasparenza dell’AI.

- Esplorare il funzionamento di XAI: Ottieni informazioni su come XAI funziona, dai dati di input alle interfacce utente.

- Vedere esempi reali: Capire come GPT-4, con e senza XAI, può influire sulla tua vita quotidiana.

- Imparare i metodi di integrazione: Scopri come GPT-4 può essere integrato con XAI utilizzando esempi di codice.

- Identificare casi d’uso: Esplora applicazioni pratiche nei settori sanitario, legale e finanziario.

Questo articolo è stato pubblicato come parte del Data Science Blogathon.

Comprensione di GPT-4

Prima di approfondire XAI, cerchiamo di cogliere l’essenza di GPT-4. Il “Generative Pre-trained Transformer 4” è l’ultima iterazione della serie dei modelli di linguaggio di OpenAI. È famoso per la sua capacità di generare testi coerenti e pertinenti dal punto di vista contestuale. I progressi di GPT-4 includono un dataset di addestramento più ampio, più parametri e capacità di messa a punto migliorate. Queste qualità lo rendono una potenza in varie applicazioni, dalla generazione di contenuti ai chatbot.

La necessità di un’Intelligenza Artificiale Esplicabile (XAI)

Cos’è l’Intelligenza Artificiale Esplicabile?

L’Intelligenza Artificiale Esplicabile (XAI) è un modo per rendere i sistemi AI più trasparenti e comprensibili. Ci aiuta a capire perché l’AI prende determinate decisioni, facilitando la fiducia e l’utilizzo dell’AI in applicazioni critiche come la sanità e la finanza.

- Il lato pratico della gestione dei rischi dell’IA

- Una guida semplice in inglese per invertire l’ingegnerizzazione del codice sorgente di Reddit con LangChain, Activeloop e GPT-4

- I Plugin ChatGPT Indispensabili per i Creatori di Contenuti

Man mano che i sistemi AI vengono sempre più integrati nella nostra vita, garantire che non siano “scatole nere” è diventato cruciale. I modelli AI a scatola nera, come alcune iterazioni delle reti neurali, prendono decisioni senza fornire informazioni sul loro ragionamento. Questa mancanza di trasparenza presenta sfide, specialmente in applicazioni critiche come la sanità, la finanza e il diritto.

Immagina una diagnosi medica generata da un sistema AI. Sebbene la diagnosi possa essere accurata, capire perché l’AI è arrivata a quella conclusione è altrettanto importante, specialmente per medici e pazienti. Qui entra in gioco l’Intelligenza Artificiale Esplicabile (XAI).

L’XAI si concentra sulla creazione di modelli AI che producono risultati e spiegano le loro decisioni. Migliorando la trasparenza, “XAI mira a costruire fiducia e responsabilità nei sistemi AI”.

Funzionamento dell’Intelligenza Artificiale Esplicabile (XAI)

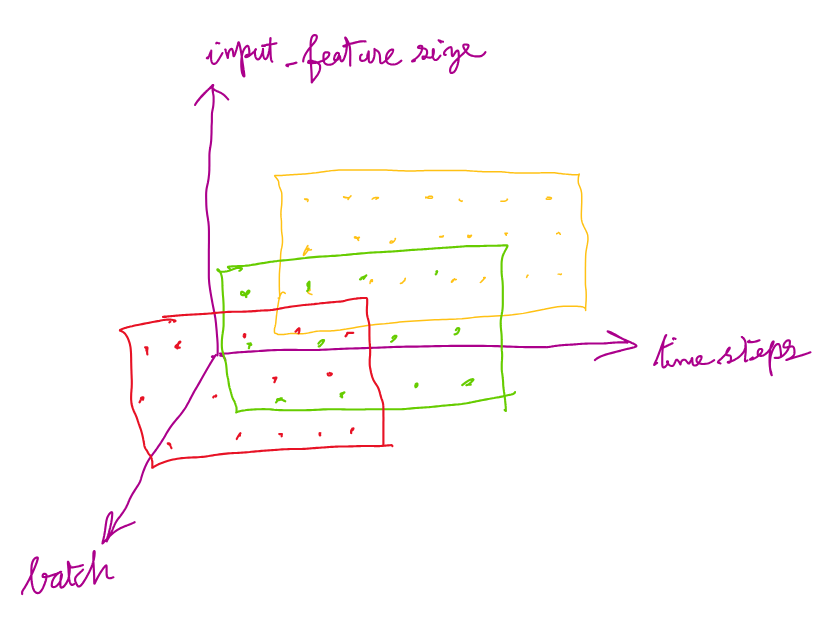

- Dati di input: XAI parte dai dati di input utilizzati per addestrare un modello di apprendimento automatico (ML). Questi dati contengono informazioni e pattern appresi dal modello.

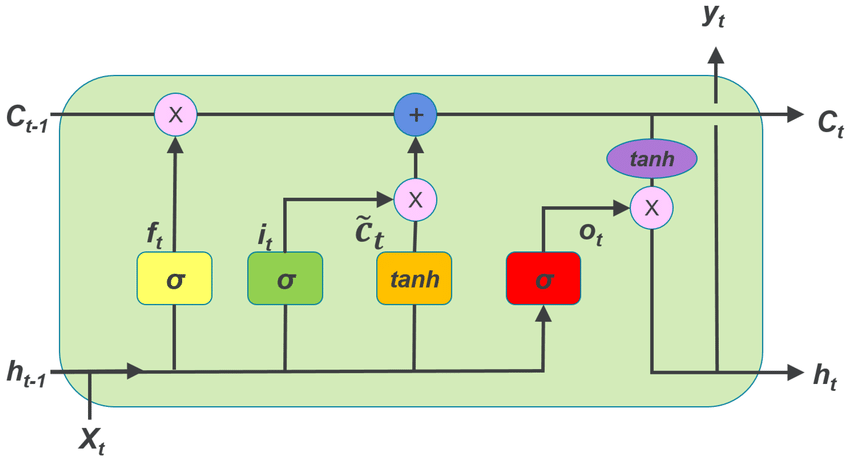

- Modello di ML: Il modello di ML è il cuore di qualsiasi sistema AI. Elabora i dati di input e prende previsioni o decisioni in base a ciò che ha appreso durante l’addestramento.

- Metodo XAI: XAI utilizza metodi e algoritmi specifici per interpretare come il modello di ML arriva alle sue previsioni. Questi metodi mirano a rendere il processo decisionale del modello trasparente e comprensibile.

- Previsioni: Il modello di ML genera previsioni o decisioni, come la classificazione di un’immagine, la raccomandazione di un prodotto o la diagnosi di una malattia. Queste previsioni possono influenzare diverse applicazioni.

- Spiegazioni: I metodi XAI producono spiegazioni che chiariscono perché il modello di ML ha fatto una determinata previsione. Queste spiegazioni sono tipicamente leggibili dall’uomo e forniscono informazioni sul ragionamento del modello.

- Interfaccia utente: Le spiegazioni vengono spesso presentate attraverso interfacce utente, rendendole accessibili. Queste interfacce possono far parte di applicazioni, cruscotti o sistemi in cui viene utilizzata l’AI.

- Portatori di interesse: L’XAI coinvolge vari portatori di interesse, tra cui scienziati dei dati, sviluppatori di AI, utenti finali e organismi di regolamentazione. I data scientist progettano e implementano metodi XAI, gli sviluppatori li integrano nei sistemi AI, gli utenti finali si affidano alle spiegazioni e i regolatori garantiscono il rispetto di standard etici e legali.

Attraverso questi componenti, XAI migliora la trasparenza e l’affidabilità dei sistemi di intelligenza artificiale, consentendo agli utenti di prendere decisioni informate basate su previsioni generate dall’IA.

Esempio di Vita Quotidiana di GPT-4 Con e Senza XAI

- Con GPT-4 e Spiegabilità dell’IA (XAI): Immagina di utilizzare un assistente vocale alimentato da GPT-4 e XAI. Quando chiedi un consiglio su un ristorante, fa domande e spiega perché ha fatto quelle scelte. Ad esempio, potrebbe dire: “Ti consiglio dei ristoranti italiani perché ti è piaciuta la cucina italiana in passato e questi posti hanno un alto punteggio degli utenti.”

- Senza Spiegabilità dell’IA: Al contrario, GPT-4 senza XAI potrebbe risultare in raccomandazioni senza giustificazioni chiare. Otterresti suggerimenti su ristoranti, ma non capiresti perché sono state fatte quelle scelte specifiche, il che potrebbe portare a una minore fiducia e sicurezza nelle raccomandazioni.

Integrazione di GPT-4 e XAI

L’integrazione di GPT-4 con XAI è un passo promettente avanti. Ecco come funziona:

Meccanismi di Attenzione

GPT-4 utilizza già meccanismi di attenzione, che possono essere ulteriormente migliorati per l’interpretabilità. Questi meccanismi mettono in evidenza le parti specifiche del testo di input che influenzano l’output del modello. Gli utenti possono capire perché GPT-4 genera determinate risposte visualizzando i modelli di attenzione.

import torch

import matplotlib.pyplot as plt

# Supponendo che tu abbia già caricato GPT-4 e un input di testo codificato come tensori

# Per scopi dimostrativi, diciamo che hai input_tokens e attention_weights

input_tokens = torch.tensor([...]) # Sostituisci con i tuoi token di input

attention_weights = torch.tensor([...]) # Sostituisci con i tuoi pesi di attenzione

# Scegli un layer e una testa per la visualizzazione

layer = 5 # Scegli un layer da visualizzare

head = 0 # Scegli una testa di attenzione da visualizzare

# Visualizza i pesi di attenzione

plt.matshow(attention_weights[layer][head].numpy(), cmap='viridis')

plt.xlabel("Token di Input")

plt.ylabel("Token di Output")

plt.title("Mappa di Calore dell'Attenzione")

plt.show()Questo codice utilizza Matplotlib per visualizzare una mappa di calore dell’attenzione, mostrando quali token di input ricevono maggiore attenzione da parte di GPT-4 per generare l’output. Puoi regolare le variabili layer e head per visualizzare diversi modelli di attenzione all’interno del modello.

Filtraggio Basato su Regole

Le tecniche di XAI possono aggiungere filtri basati su regole agli output di GPT-4. Ad esempio, se GPT-4 genera una raccomandazione medica, XAI può assicurarsi che rispetti le linee guida mediche stabilite.

import openai

# Inizializza OpenAI GPT-4

gpt4 = openai.ChatCompletion.create(

model="gpt-4.0-turbo",

messages=[

{"role": "system", "content": "Sei un assistente utile."},

{"role": "user", "content": "Genera una raccomandazione medica."},

]

)

# Definisci una funzione di filtro basata su regole

def medical_recommendation_filter(response):

# Implementa qui la tua logica di filtraggio

if "prescrivere" in response["choices"][0]["message"]["content"]:

return "Non posso fornire prescrizioni mediche. Si prega di consultare un professionista sanitario."

else:

return response["choices"][0]["message"]["content"]

# Ottieni la risposta di GPT-4

response = gpt4['choices'][0]['message']

# Applica il filtro basato su regole

filtered_response = medical_recommendation_filter(response)In questo codice, GPT-4 di OpenAI viene inizializzato per generare risposte. Viene definita una funzione di filtraggio basata su regole per elaborare le risposte di GPT-4. Se una risposta contiene determinate parole chiave, come “prescrivere”, il filtro impedisce al modello di fornire prescrizioni mediche. Questo frammento di codice mostra come aggiungere regole personalizzate per controllare e filtrare le risposte di GPT-4 in base a requisiti specifici o misure di sicurezza.

Interfacce Interattive

Creare interfacce user-friendly che consentano agli utenti di interrogare GPT-4 per ottenere spiegazioni può colmare il divario tra l’IA e gli esseri umani. Gli utenti possono chiedere: “Perché hai fatto questa raccomandazione?” e ricevere risposte coerenti.

from flask import Flask, request, render_template

import openai

# Inizializza l'applicazione Flask

app = Flask(__name__)

# Imposta qui la tua chiave API di OpenAI

openai.api_key = "<your_API_Key>"

# Definisci una route per la home page

@app.route("/")

def home():

return render_template("index.html")

# Definisci una route per gestire le domande degli utenti

@app.route("/ask", methods=["POST"])

def ask_question():

# Ottieni l'input dell'utente dal modulo

user_input = request.form["question"]

# Genera una risposta da GPT-4

response = generate_gpt_response(user_input)

# Genera una spiegazione usando il tuo componente XAI

explanation = generate_xai_explanation(response)

# Restituisci la risposta e la spiegazione all'utente

return render_template("result.html", response=response, explanation=explanation)

# Funzione per generare una risposta da GPT-4

def generate_gpt_response(question):

# Puoi utilizzare qui il tuo modello GPT preferito

response = "Questa è una risposta di GPT-4 alla domanda: " + question

return response

# Funzione per generare una spiegazione XAI

def generate_xai_explanation(response):

# Qui va la tua logica di componente XAI

explanation = "Questa è una spiegazione del motivo per cui GPT-4 ha fornito la risposta sopra."

return explanation

if __name__ == "__main__":

app.run(debug=True)

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<meta name="viewport" content="width=device-width, initial-scale=1.0">

<title>Demo GPT-4 + XAI</title>

</head>

<body>

<h1>Benvenuto alla Demo GPT-4 + XAI</h1>

<form action="/ask" method="POST">

<label for="question">Fai una domanda:</label>

<input type="text" name="question" id="question" required>

<button type="submit">Chiedi</button>

</form>

</body>

</html>Questo è il codice per index.html

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<meta name="viewport" content="width=device-width, initial-scale=1.0">

<title>Risultato GPT-4 + XAI</title>

</head>

<body>

<h1>La tua risposta GPT-4</h1>

<p>{{ response }}</p>

<h2>Spiegazione</h2>

<p>{{ explanation }}</p>

</body>

</html>Questo codice è per results.html

Ecco le immagini dello schermo di come viene eseguito effettivamente

Questo codice dimostra come visualizzare i meccanismi di attenzione all’interno di GPT-4, che evidenziano come il modello presti attenzione a diverse parti del testo di input durante la generazione dell’output. Carica un modello GPT-4 e un tokenizer, codifica un testo di esempio ed estrae i pesi di attenzione. Questi pesi vengono poi visualizzati utilizzando una mappa di calore per mostrare quali token nel testo di input ricevono maggiore attenzione dal modello, aiutandoci a comprendere il suo processo decisionale.

Casi d’uso

L’integrazione di GPT-4 con XAI ha un enorme potenziale in vari ambiti:

- Sanità: GPT-4 può aiutare i professionisti medici nella diagnosi e nelle raccomandazioni di trattamento, fornendo spiegazioni trasparenti per le sue proposte.

# GPT-4 genera una diagnosi medica

diagnosi = gpt4.genera_diagnosi_medica(sintomi)

# XAI aggiunge spiegazioni alla diagnosi

spiegazione = xai.spiega_diagnosi(diagnosi)

# Mostra la diagnosi e la spiegazione

print("Diagnosi medica:", diagnosi)

print("Spiegazione:", spiegazione)Sommario del codice: Nel campo della sanità, GPT-4 genera una diagnosi medica basata sui sintomi inseriti. XAI spiega quindi la diagnosi, fornendo informazioni su perché è stata effettuata una determinata diagnosi.

- Legale: GPT-4 con XAI può aiutare nella ricerca legale spiegando in modo esaustivo i precedenti e le decisioni giuridiche.

# GPT-4 aiuta nella ricerca legale

informazioni_legali = gpt4.genera_informazioni_legali(query)

# XAI assicura spiegazioni sulle informazioni legali

spiegazione = xai.spiega_informazioni_legali(informazioni_legali)

# Presenta le informazioni legali e le spiegazioni

print("Informazioni legali:", informazioni_legali)

print("Spiegazione:", spiegazione)Sommario del codice: Nel campo legale, GPT-4 aiuta nella ricerca legale generando informazioni in risposta alle domande dell’utente. XAI integra queste informazioni con spiegazioni chiare per una migliore comprensione dei precedenti giuridici.

- Finanza: Nel settore finanziario, può fornire informazioni interpretabili sulle tendenze di mercato e le strategie di investimento.

# GPT-4 fornisce raccomandazioni di investimento

raccomandazioni = gpt4.genera_raccomandazioni_di_investimento(strategia)

# XAI aggiunge spiegazioni alle raccomandazioni di investimento

spiegazione = xai.spiega_raccomandazioni_di_investimento(raccomandazioni)

# Mostra le raccomandazioni di investimento e le spiegazioni

print("Raccomandazioni di investimento:", raccomandazioni)

print("Spiegazione:", spiegazione)Sommario del codice: GPT-4 offre raccomandazioni di investimento basate su una strategia specificata nel settore finanziario. XAI migliora queste raccomandazioni con spiegazioni, aiutando gli utenti a comprendere il ragionamento dietro le proposte.

Sfide e direzioni future

Anche se la fusione di GPT-4 e XAI è promettente, non è priva di sfide:

- Complessità: Sviluppare tecniche XAI che possano spiegare in modo efficace le risposte di GPT-4, soprattutto per compiti complessi, rimane una sfida.

- Prevenire i pregiudizi: Assicurare che le spiegazioni siano imparziali ed equilibrate è essenziale. I modelli AI come GPT-4 possono apprendere involontariamente pregiudizi dai dati di addestramento, il che deve essere affrontato.

Vantaggi del colmare il divario

- Trasparenza e Responsabilità: Unendo GPT-4 con XAI si elimina il problema della “scatola nera” dell’IA. Gli utenti ottengono una comprensione di come l’IA giunge a conclusioni, favorendo la trasparenza e la responsabilità.

- Adozione più ampia dell’IA: Questa combinazione allarga il campo di applicazione dell’IA ad aree vitali come la sanità, la finanza e il diritto. La capacità degli utenti di capire il ragionamento dell’IA incoraggia la fiducia e l’adozione.

- Fiducia potenziata: La fiducia è fondamentale nell’accettazione dell’IA. Comprendere perché l’IA suggerisce determinate azioni costruisce fiducia, aumentando la fiducia dell’utente.

- Emancipazione degli utenti: L’integrazione di GPT-4 e XAI permette agli utenti di porre domande, cercare spiegazioni e prendere decisioni informate basate su informazioni generate dall’IA.

Conclusioni

In conclusione, GPT-4 e Explainable AI (XAI) rappresentano la convergenza di modelli di linguaggio avanzati e interpretabilità, creando sistemi di intelligenza artificiale che sono sia linguisticamente competenti che comprensibili. Nonostante le sfide rimangano, il potenziale di questi sistemi integrati per potenziare.

Punti chiave

- Abilità linguistica di GPT-4: GPT-4, l’ultimo nella serie di modelli di linguaggio di OpenAI, eccelle nella generazione di testo coerente, rendendolo uno strumento versatile per varie applicazioni.

- La necessità di XAI: Con l’integrazione dei sistemi di intelligenza artificiale nella nostra vita, Explainable AI (XAI) è cruciale per garantire trasparenza e responsabilità nelle decisioni dell’IA.

- Integrazione per la trasparenza: Combinare GPT-4 con XAI implica il potenziamento dei meccanismi di attenzione, il filtraggio basato su regole e le interfacce interattive per rendere le decisioni dell’IA comprensibili.

- Abbondanza di casi d’uso: Questa integrazione ha ampie applicazioni, dalla sanità al diritto alla finanza, migliorando la presa di decisioni in questi ambiti.

- Sfide e preoccupazioni di parzialità: Le sfide includono l’affrontare la complessità delle spiegazioni e mitigare i pregiudizi che i modelli di IA come GPT-4 possono ereditare.

- Fiducia e responsabilità: Il colmare il divario tra GPT-4 e XAI favorisce la fiducia nelle raccomandazioni dell’IA fornendo agli utenti una comprensione del processo decisionale dell’IA.

Domande frequenti

Le immagini mostrate in questo articolo non sono di proprietà di Analytics Vidhya e sono utilizzate a discrezione dell’autore.