Pricing dinamico con apprendimento per rinforzo da zero Q-Learning

Dynamic pricing with zero Q-Learning reinforcement learning

Un’introduzione al Q-Learning con un esempio pratico in Python

Indice

- Introduzione

- Una guida introduttiva all’Apprendimento per Rinforzo2.1 Concetti chiave2.2 Funzione Q2.3 Valore Q2.4 Q-Learning2.5 Equazione di Bellman2.6 Esplorazione vs. sfruttamento2.7 Tabella Q

- Il problema del Pricing Dinamico3.1 Enunciato del problema3.2 Implementazione

- Conclusioni

- Riferimenti

1. Introduzione

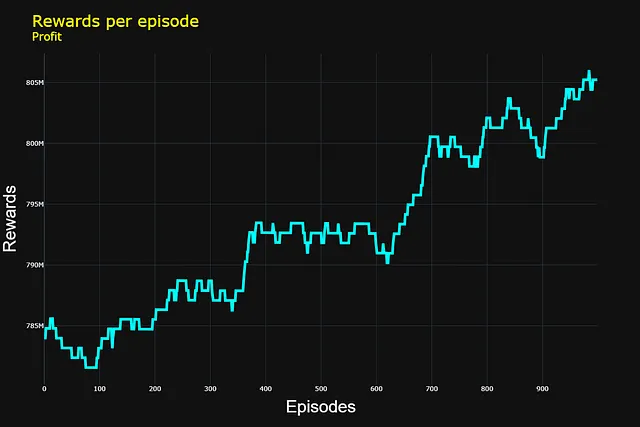

In questo post, introduciamo i concetti fondamentali dell’Apprendimento per Rinforzo e approfondiamo il Q-Learning, un approccio che permette agli agenti intelligenti di apprendere politiche ottimali prendendo decisioni informate basate su ricompense ed esperienze.

Condivideremo anche un esempio pratico in Python costruito da zero. In particolare, addestreremo un agente ad apprendere l’arte della determinazione dei prezzi, un aspetto cruciale del business, in modo che possa imparare come massimizzare il profitto.

Senza ulteriori indugi, iniziamo il nostro viaggio.

2. Una guida introduttiva all’Apprendimento per Rinforzo

2.1 Concetti chiave

L’Apprendimento per Rinforzo (RL) è un’area dell’Apprendimento Automatico in cui un agente impara a compiere un compito tramite tentativi ed errori.

- Meta AI presenta SeamlessM4T un modello fondamentale multilingue e multitasking che traduce e trascrive senza soluzione di continuità tra il linguaggio parlato e il testo.

- Incontra TADA un potente approccio di intelligenza artificiale per convertire descrizioni verbali in avatar 3D espressivi

- Oltre i grafici a barre dati con Sankey, imballaggio circolare e grafi di rete

In breve, l’agente prova azioni che sono associate a un feedback positivo o negativo attraverso un meccanismo di ricompensa. L’agente modifica il suo comportamento per massimizzare una ricompensa, imparando così il percorso migliore per raggiungere l’obiettivo finale.

Introduciamo i concetti chiave dell’RL attraverso un esempio pratico. Immaginiamo un gioco arcade semplificato, in cui un gatto deve navigare in un labirinto per raccogliere tesori – un bicchiere di latte e una pallina di lana – evitando nel contempo i cantieri edili:

- L’agente è colui che sceglie il corso delle azioni. Nell’esempio, l’agente è il giocatore che controlla il joystick decidendo la prossima mossa del gatto.

- L’ambiente è il…