Ricercatori dell’ETH Zurigo presentano GoT (Graph of Thoughts) un framework di machine learning che migliora le capacità di suggerimento nei grandi modelli di linguaggio (LLM).

Researchers from ETH Zurich present GoT (Graph of Thoughts), a machine learning framework that enhances suggestion capabilities in large language models (LLMs).

L’Intelligenza Artificiale (IA) ha visto un aumento nell’uso dei Large Language Models (LLM). Un particolare tipo di LLM che si basa sul design del solo decodificatore dell’architettura Transformer ha acquisito molta popolarità di recente. Modelli come GPT, PaLM e LLaMA hanno guadagnato enorme popolarità di recente. L’ingegneria delle istruzioni è una tecnica strategica che rappresenta un modo efficiente di utilizzare gli LLM per affrontare diverse problematiche, con l’obiettivo principale di incorporare istruzioni specifiche per l’attività nell’input testuale. Se queste istruzioni vengono scritte correttamente, gli LLM possono utilizzare il loro approccio token-based autoregressivo per creare testo pertinente e completare l’attività.

Il metodo Chain-of-Thought (CoT) si basa sull’ingegneria delle istruzioni. In CoT, l’input fornisce pensieri o passi intermedi di deliberazione oltre alla descrizione dell’attività. Questa aggiunta migliora notevolmente la capacità degli LLM di risolvere problemi senza la necessità di aggiornamenti del modello. Confrontando le capacità degli LLM con i paradigmi attuali come Chain-of-Thought e Tree of Thoughts (ToT), è stato introdotto di recente un nuovo framework chiamato Graph of Thoughts (GoT).

GoT rappresenta i dati come un grafo arbitrario, consentendo agli LLM di generare e gestire i dati in modo più flessibile. I singoli pezzi di informazione, o pensieri degli LLM, sono rappresentati come vertici in questo grafo, mentre le connessioni e le dipendenze tra di essi sono rappresentate come archi. Ciò consente di combinare diverse idee degli LLM per ottenere risultati più potenti ed efficaci. Questo viene realizzato permettendo a questi pensieri di essere accoppiati e interdipendenti all’interno del grafo. A differenza dei paradigmi lineari che limitano il pensiero, GoT può registrare complessi network di pensieri. Ciò apre la porta alla combinazione di diverse idee in una risposta coerente, riducendo i network di pensiero complessi ai loro componenti essenziali e migliorando le idee attraverso loop di feedback.

- 10 Migliori generatori di avatar AI nel 2023

- Discesa più ripida e Metodo di Newton in Python, da zero Un confronto

- Insegnare ai modelli di linguaggio ad utilizzare gli strumenti

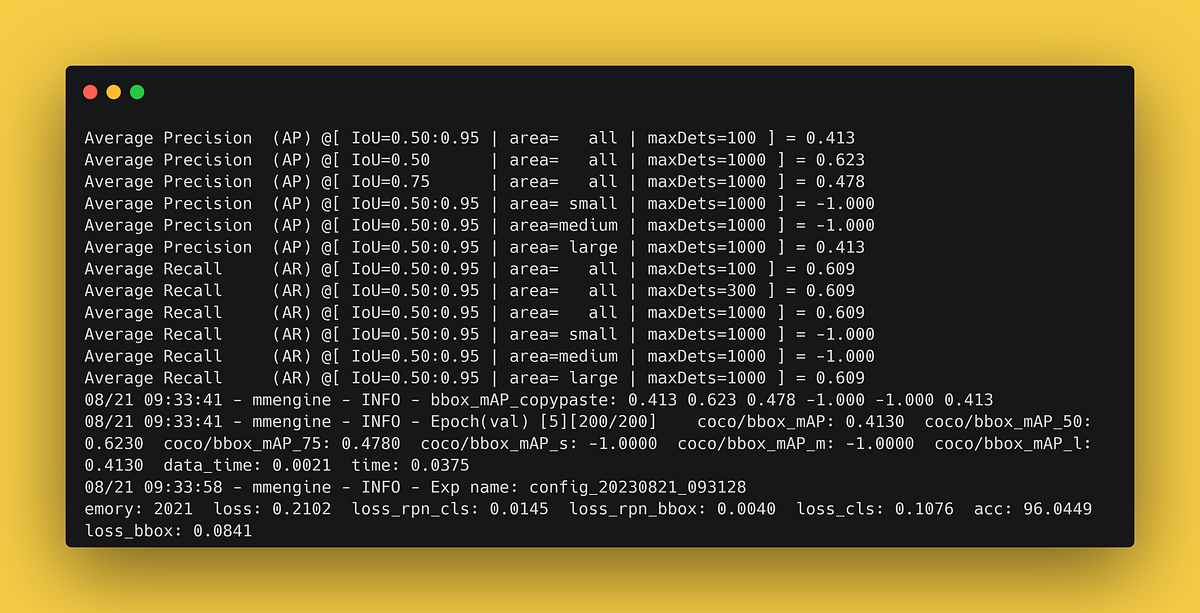

Le maggiori prestazioni di GoT rispetto ai metodi esistenti su più attività servono a dimostrarne l’efficacia. GoT supera ToT in un test di ordinamento aumentando la qualità dell’ordinamento del 62%. Allo stesso tempo, riduce le spese di calcolo di oltre il 31%. Questi risultati dimostrano la capacità di GoT di bilanciare l’accuratezza dell’attività con l’efficienza delle risorse. L’estensibilità di GoT è uno dei suoi vantaggi più evidenti. Il framework è sufficientemente flessibile da guidare schemi di prompting creativi, poiché si adatta facilmente a nuove trasformazioni di idee. Questa flessibilità è essenziale per navigare nel panorama della ricerca e dell’applicazione degli LLM man mano che cambia.

Questo lavoro fa progredire significativamente l’allineamento del ragionamento degli LLM con i processi di pensiero umani e i sistemi cerebrali attraverso l’istituzione del framework GoT. I pensieri interagiscono, si diramano e si influenzano a vicenda in complessi network sia nei processi di pensiero umani che cerebrali. Pertanto, GoT migliora le competenze degli LLM e la loro capacità di gestire problemi complessi, colmando il divario tra le tecniche lineari convenzionali e questi sofisticati processi mentali a rete.