Essere audaci sull’Intelligenza Artificiale significa essere responsabili fin dall’inizio.

Boldness in Artificial Intelligence means being responsible from the start.

Noi crediamo che il nostro approccio all’Intelligenza Artificiale debba essere audace e responsabile. Per noi questo significa sviluppare l’AI in modo da massimizzare i benefici positivi per la società affrontando le sfide, guidati dai nostri Principi di AI. Sebbene ci sia una tensione naturale tra i due, crediamo che sia possibile – e infatti essenziale – abbracciare quella tensione in modo produttivo. L’unico modo per essere veramente audaci a lungo termine è essere responsabili fin dall’inizio.

Stiamo applicando audacemente l’AI nei nostri prodotti innovativi utilizzati dalle persone ovunque, nei nostri contributi ai progressi scientifici che beneficiano le persone e nel contribuire ad affrontare le sfide sociali.

Nei nostri prodotti

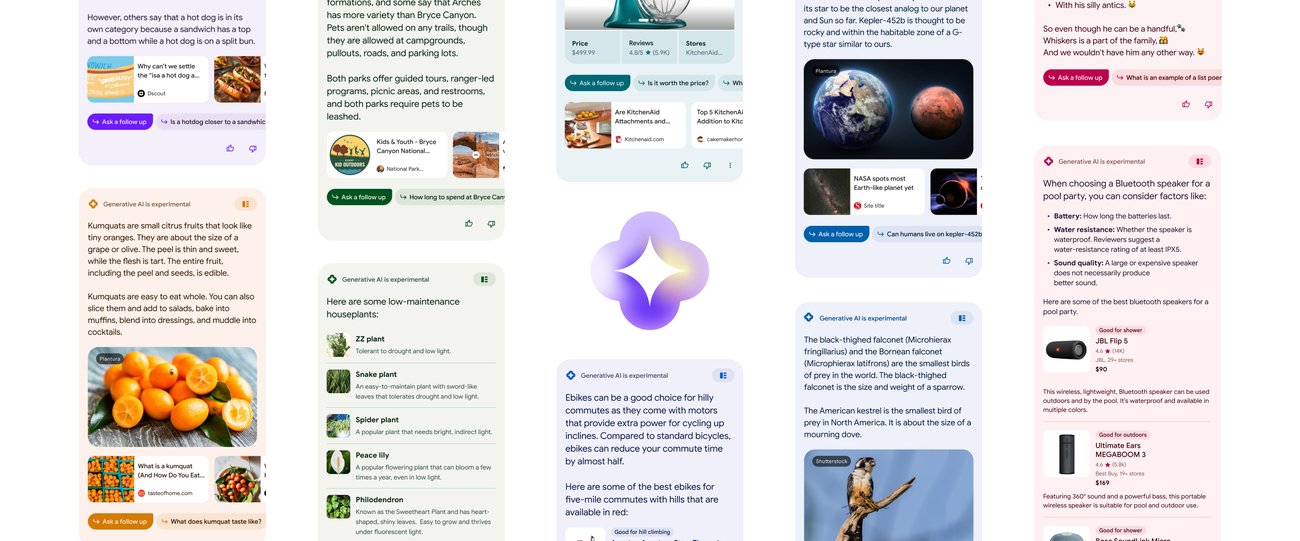

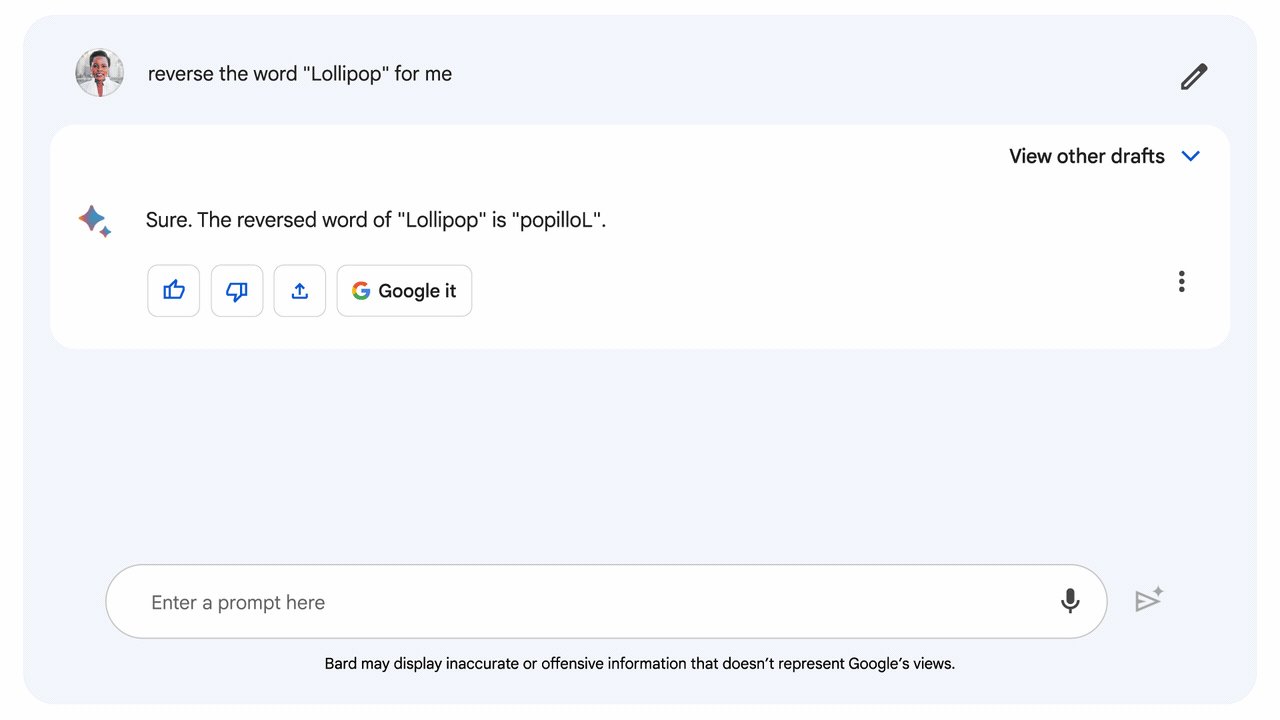

L’AI è già presente in molti prodotti utilizzati da milioni (e in alcuni casi miliardi) di persone come Google Maps, Google Translate, Google Lens e altri ancora. E ora stiamo portando l’AI per aiutare le persone ad accendere e assistere la loro creatività con Bard, aumentare la loro produttività con gli strumenti di Workspace e rivoluzionare il modo in cui accedono alla conoscenza con Search Generative Experience. Alcuni altri esempi e sperimenti precoci di applicazioni utili possono essere trovati in Google Labs.

Nel contribuire ad affrontare le sfide sociali

Stiamo applicando l’AI per mitigare e adattarsi ai cambiamenti climatici: fornendo previsioni di alluvioni critiche – ora in più di 20 paesi, seguendo in tempo reale i confini degli incendi boschivi e contribuendo a ridurre le emissioni di carbonio diminuendo il traffico stop-and-go. Stiamo applicandolo per migliorare la salute, incluso l’assistenza materna, i trattamenti contro il cancro e lo screening della tubercolosi. E abbiamo recentemente annunciato un nuovo grande modello di lingua che potrebbe essere uno strumento utile per i clinici: Med-PaLM. Più tardi quest’anno, Data Commons – un sistema che organizza i dati provenienti da centinaia di fonti per informare gli approcci alle principali sfide sociali dalla sostenibilità alla salute al lavoro e all’economia in molti paesi – sarà accessibile attraverso Bard, rendendolo ancora più utile.

- Gioca a I/O FLIP, il nostro gioco di carte progettato dall’intelligenza artificiale.

- Presentiamo il Progetto Gameface un mouse da gioco alimentato dall’IA senza l’uso delle mani.

- 100 cose che abbiamo annunciato a I/O 2023

Nella nostra ricerca definitiva nel campo

L’AI sta aiutando gli scienziati a compiere grandi progressi in molti campi dalla fisica, alla scienza dei materiali e alla salute che beneficeranno la società. Prendiamo ad esempio il programma AlphaFold di Google DeepMind. AlphaFold può prevedere con precisione la forma tridimensionale di 200 milioni di proteine, quasi tutte le proteine catalogate note alla scienza – un risultato che ci ha dato l’equivalente di quasi 400 milioni di anni di progresso nella ricerca in poche settimane. L’AI sta anche alimentando i progressi nel rendere accessibile alle persone di tutto il mondo le informazioni del mondo. Ad esempio, sta consentendo imprese ambiziose come la nostra iniziativa moonshot 1,000 Languages – abbiamo fatto progressi entusiasmanti verso il nostro obiettivo di supportare le 1.000 lingue più parlate con un Modello di discorso universale addestrato su oltre 400 lingue.

Sfide

Sebbene sia entusiasmante vedere questi audaci progressi, sappiamo che l’AI è ancora una tecnologia emergente – e c’è ancora molto da fare. È anche importante riconoscere che l’AI ha il potenziale per aggravare le sfide sociali esistenti, come il bias ingiusto, e porre nuove sfide man mano che diventa più avanzata e emergono nuovi utilizzi, come evidenziato dalla nostra stessa ricerca e da quella degli altri. Ecco perché crediamo che sia imperativo adottare un approccio responsabile all’AI, guidato dai Princìpi di AI che abbiamo stabilito per la prima volta nel 2018. Ogni anno pubblichiamo rapporti di progresso su come mettiamo in pratica i nostri Principi di AI che approfondiscono gli esempi. Questo lavoro continua, poiché l’AI diventa più capace e impariamo dagli utenti e dai nuovi utilizzi delle tecnologie, e condividiamo ciò che apprendiamo.

Valutare le informazioni

Una zona che è in cima alla mente di molti – inclusi noi – è la disinformazione. L’AI generativo rende più facile che mai creare nuovi contenuti, ma solleva anche ulteriori questioni sulla affidabilità delle informazioni online. Ecco perché continuiamo a sviluppare e fornire alle persone strumenti per valutare le informazioni online. Nei prossimi mesi, stiamo aggiungendo un nuovo strumento “Informazioni su questa immagine” in Google Search. “Informazioni su questa immagine” fornirà un contesto utile come quando e dove potrebbero essere apparse per la prima volta immagini simili e dove altro sono state viste online, inclusi siti di notizie, di fact checking e social. Più tardi quest’anno, “Informazioni su questa immagine” sarà disponibile in Chrome e Google Lens.

Princìpi di AI in azione

Mentre applichiamo i nostri Principi di AI ai nostri prodotti, iniziamo anche a vedere potenziali tensioni quando si tratta di essere audaci e responsabili. Ad esempio, Universal Translator è un servizio sperimentale di doppiaggio video AI che aiuta gli esperti a tradurre la voce di un oratore e abbinare i loro movimenti delle labbra. Questo ha un enorme potenziale per aumentare la comprensione dell’apprendimento; tuttavia, conoscendo i rischi che potrebbe comportare nelle mani di attori malintenzionati, abbiamo costruito il servizio con guardrail per limitare l’abuso e renderlo accessibile solo ai partner autorizzati.

Un altro modo in cui rispettiamo i nostri Principi di AI è con innovazioni per affrontare le sfide man mano che emergono. Ad esempio, siamo tra i primi nell’industria ad automatizzare il testing avversario utilizzando LLM, il che ha significativamente migliorato la velocità, la qualità e la copertura del testing, consentendo agli esperti di sicurezza di concentrarsi su casi più difficili. Per contribuire ad affrontare la disinformazione, integreremo presto nuove innovazioni in watermarking, metadati e altre tecniche nei nostri ultimi modelli generativi. Stiamo anche progredendo su strumenti per rilevare l’audio sintetico: nel nostro lavoro di AudioLM, abbiamo addestrato un classificatore in grado di rilevare l’audio sintetico nel nostro stesso modello AudioLM con una precisione quasi del 99%.

Uno sforzo collettivo

Sappiamo che costruire l’AI in modo responsabile deve essere uno sforzo collettivo che coinvolge ricercatori, scienziati sociali, esperti del settore, governi, creatori, editori e persone che utilizzano l’AI nella loro vita quotidiana.

Condividiamo le nostre innovazioni con gli altri per aumentare l’impatto, come nel caso di Perspective API, che è stato originariamente sviluppato dai nostri ricercatori presso Jigsaw per mitigare la tossicità trovata nei commenti online. Ora lo stiamo applicando ai nostri grandi modelli linguistici (LLM), inclusi tutti i modelli menzionati a I/O, e i ricercatori accademici lo hanno utilizzato per creare una valutazione di standard industriale utilizzata da tutti i modelli LLM significativi, compresi i modelli di OpenAI e Anthropic.

Crediamo che tutti traggano beneficio da un ecosistema web vibrante, oggi e in futuro. Per supportarlo, lavoreremo con la comunità web su modi per dare ai publisher web scelta e controllo sul loro contenuto web.

Parte di ciò che rende così emozionante l’area di focus dell’AI è che il potenziale per beneficiare persone e società ovunque è immenso e tangibile, come l’imperativo di svilupparlo e usarlo in modo responsabile. Molto sta cambiando ed evolvendo man mano che l’AI avanza e sempre più persone lo sperimentano, condividono, sviluppano e lo usano. Impariamo costantemente dalla nostra ricerca, dalle nostre esperienze, dagli utenti e dalla comunità più ampia e incorporiamo ciò che impariamo nel nostro approccio. Guardando avanti, c’è così tanto che possiamo realizzare e così tanto che dobbiamo fare bene – insieme.

Vorrei ringraziare e riconoscere il lavoro complesso e ispiratore dei miei colleghi dei team di Responsabile AI, Responsabile Innovazione, Google.org, Labs, Jigsaw, Google Research e Google DeepMind.